Cientistas descobrem uma maneira de converter pensamentos em voz via computador

Um computador que visa traduzir pensamentos em falas soando natural tem sido saudado por seus desenvolvedores como um avanço “emocionante”.

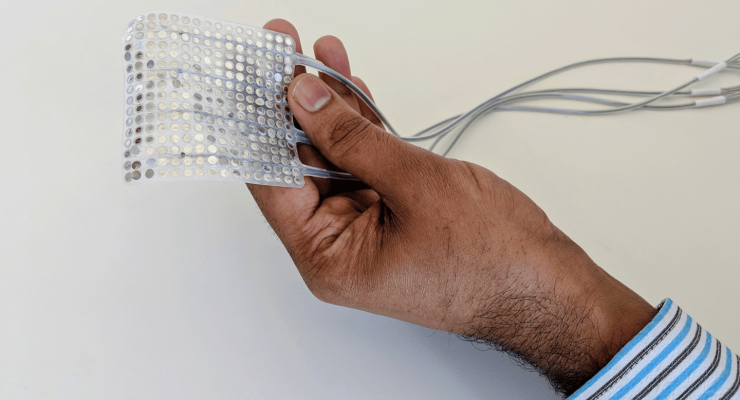

Pesquisadores da Universidade da Califórnia, em San Francisco, projetaram o sistema – uma simulação por computador que transforma sinais cerebrais em voz virtual – para ajudar a restaurar a fala de pessoas com paralisia ou danos neurológicos. Eles publicaram seu artigo na revista científica “Nature” na quarta-feira.

O dispositivo funciona usando uma interface cérebro-computador (BCI), que elabora as intenções de fala de uma pessoa, combinando sinais cerebrais com movimentos físicos que geralmente ativariam no trato vocal de uma pessoa – laringe, mandíbula, lábios e língua. Os dados são então traduzidos por um computador para palavras faladas. A mesma técnica tem sido usada para gerar movimento de membros em pessoas com paralisia.

Os sistemas anteriores da BCI para a facilitação da fala concentraram-se na digitação, geralmente permitindo que as pessoas digitassem no máximo 10 palavras por minuto – muito mais lentas em relação à velocidade média de fala de cerca de 150 palavras por minuto.

Os cientistas trabalharam com cinco voluntários cuja atividade cerebral estava sendo monitorada como parte de um tratamento para a epilepsia. Os pesquisadores registraram atividade em uma região do cérebro que produz linguagem, enquanto os voluntários liam centenas de sentenças em voz alta.

Pesquisadores que trabalham no projeto alegaram que o sistema de computador não apenas restauraria a fala, mas poderia eventualmente reproduzir a “musicalidade” da voz humana que transmite as emoções e a personalidade de um falante.

“Pela primeira vez, este estudo demonstra que podemos gerar frases inteiras com base na atividade cerebral de um indivíduo”, disse Edward Chang, professor de cirurgia neurológica e autor sênior do estudo, em um comunicado de imprensa. “Esta é uma prova estimulante de princípio de que com a tecnologia que já está ao nosso alcance, devemos ser capazes de construir um dispositivo que seja clinicamente viável em pacientes com perda de fala.”

Gopala Anumanchipalli, um cientista de fala que liderou a pesquisa, disse que o avanço veio ligando a atividade do cérebro aos movimentos na boca e garganta durante a fala, em vez de associar os sinais cerebrais à acústica e aos sons.

“Raciocinamos que, se esses centros de fala no cérebro estão codificando movimentos em vez de sons, devemos tentar fazer o mesmo na decodificação desses sinais”, disse ele no comunicado de imprensa.

Até 69% das palavras geradas pelo computador foram identificadas com precisão por pessoas solicitadas a transcrever a voz do computador. Pesquisadores disseram que esta foi uma taxa significativamente melhor do que a obtida em estudos anteriores.

“Ainda temos um jeito de imitar perfeitamente a linguagem falada”, disse Josh Chartier, um estudante de pós-graduação em bioengenharia que trabalhou na pesquisa. “Somos muito bons em sintetizar sons de fala mais lentos como ‘sh’ e ‘z’, bem como manter os ritmos e entonações da fala e o gênero e a identidade do locutor, mas alguns dos sons mais abruptos como ‘b’s e’ p’s um pouco confuso. Ainda assim, os níveis de precisão que produzimos aqui seriam uma melhoria incrível na comunicação em tempo real, em comparação com o que está atualmente disponível ”.

Com informações da Revista Nature e da Universidade de San Francisco